Die neuen Verpflichtungen gemäß AI Act ab Februar 2025: Wie sich Organisationen jetzt optimal vorbereiten können

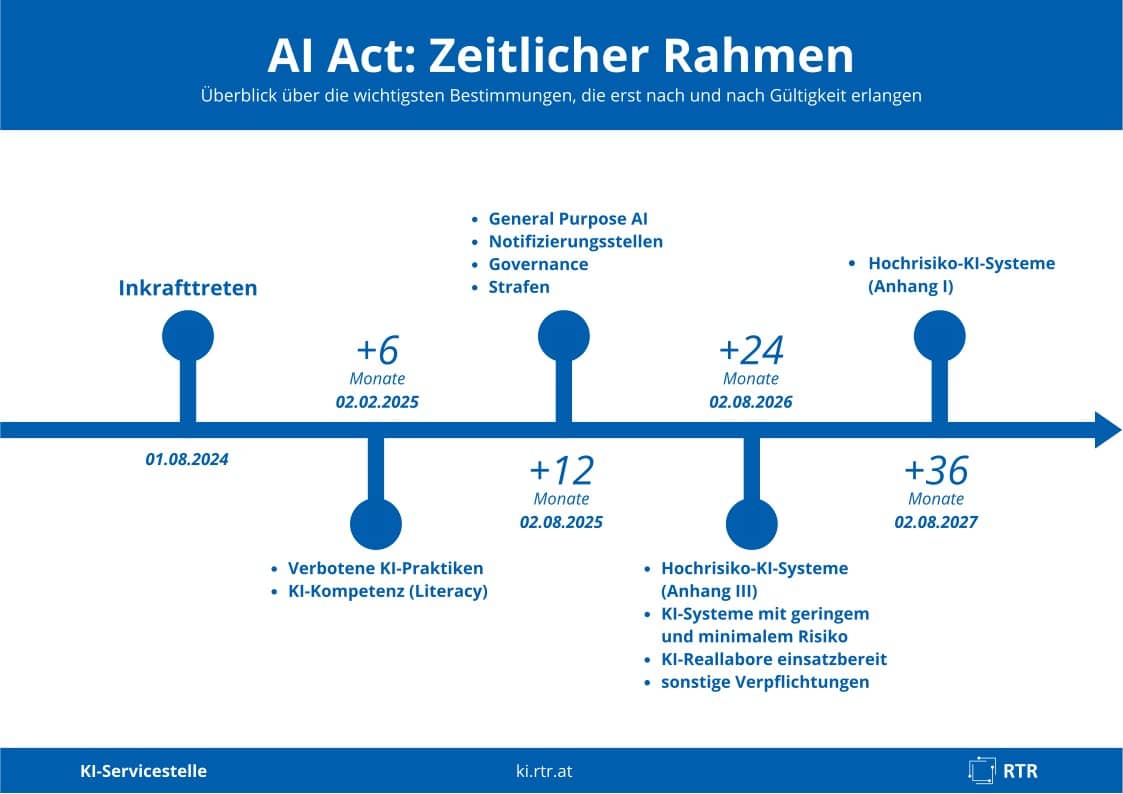

Der AI Act (Artificial Intelligence Act) bzw im Deutschen die Verordnung über Künstliche Intelligenz (KI-VO) wurde am 12. Juli 2024 offiziell im Amtsblatt der Europäischen Union veröffentlicht und trat im August 2024 in Kraft (wir berichteten). Damit liegt erstmals eine umfassende EU-weite Regelung für den Umgang mit Künstlicher Intelligenz (KI) vor, die sektorunabhängig gilt. Die Vorschriften des AI Act sehen eine mehrstufige Implementierungsphase vor, in der die meisten Bestimmungen ab August 2026 anwendbar werden. Einige wesentliche Teile gelten jedoch bereits ab dem 02. Februar 2025. Für Behörden, Unternehmen, Vereine und andere Organisationen ergibt sich daraus dringender Handlungsbedarf. In diesem Blogbeitrag erläutern wir Ihnen, welche Schritte jetzt notwendig sind, um frühzeitig Compliance sicherzustellen und welche konkreten Vorgaben sich aus den ersten anwendbaren Regelungen des AI Act ergeben.

Allgemeine Bestimmungen (Artikel 1–3)

Die Artikel 1 bis 3 schaffen die Grundlage des AI Act und definieren dessen Geltungsbereich sowie zentrale Begriffe:

- Gegenstand und Zielsetzung: Artikel 1 bekräftigt das Bekenntnis zu vertrauenswürdiger KI, dem Schutz von Gesundheit, Sicherheit und Grundrechten sowie zur Förderung von Innovation im KI-Bereich.

- Anwendungsbereich: Artikel 2 erstreckt den AI Act auf alle natürlichen und juristischen Personen, die KI-Systeme in der EU in Verkehr bringen bzw. in Betrieb nehmen, ihren Sitz in der EU haben oder deren KI-Ausgaben in der EU verwendet werden. Von der Regulierung ausgenommen sind beispielsweise KI-Systeme, die ausschließlich militärischen Zwecken, wissenschaftlicher Forschung oder rein zum persönlichen Gebrauch dienen.

- Begriffsbestimmungen: Artikel 3 erläutert zentrale Definitionen, insbesondere was als „KI-System“ im Sinne der Verordnung anzusehen ist.

Verbotene Praktiken (Artikel 5)

Ab dem 02. Februar 2025 sind bestimmte KI-Praktiken strikt untersagt, da sie laut EU-Gesetzgeber im Widerspruch zu den Werten der EU stehen, insbesondere den in der Grundrechtecharta verankerten Grundrechten. Artikel 5 verbietet insbesondere folgende KI-Systeme bzw. deren Einsatz:

- KI-Systeme zur unterschwelligen Beeinflussung, Manipulation oder Täuschung

- KI-Systeme, welche die Schutzbedürftigkeit bestimmter Personengruppen (z. B. Kinder, Ältere, Menschen mit Behinderung) ausnutzen

- KI-Systeme zum sogenannten „social scoring“

- KI-Systeme zum sogenannten „predictive policing“ (Vorhersage, ob eine Person eine Straftat begehen wird)

- KI-Systeme zur Erstellung von Datenbanken für Gesichtserkennung durch ungezieltes Auslesen von Gesichtsbildern (z. B. sog. „scraping“ von Bildern aus dem Internet)

- KI-Systeme zur Emotionserkennung am Arbeitsplatz oder in Bildungseinrichtungen (in anderen Bereichen hingegen nicht untersagt, sondern als Hochrisiko-KI-Systeme eingestuft)

- KI-Systeme zur biometrischen Kategorisierung

- Echtzeit-Fernidentifizierungssysteme in öffentlich zugänglichen Räumen zu Strafverfolgungszwecken (mit zahlreichen Ausnahmen)

Diese Verbote gelten für Unternehmen aller Branchen, die entsprechende KI-Lösungen entwickeln, beschaffen oder betreiben und gleichfalls großteils für staatliche KI-Systeme.

„AI literacy“/KI-Kompetenz (Artikel 4)

Artikel 4 gilt ungeachtet der Risikoeinstufung der KI-Anwendung und verpflichtet Anbieter bzw. Betreiber von KI-Systemen, ein ausreichendes Maß an „KI-Kompetenz“ im Unternehmen sicherzustellen. Die Erläuterungen spezifizieren, dass Mitarbeiter*innen und andere Personen mit den notwendigen Kompetenzen auszustatten sind, um fundierte Entscheidungen über KI-Systeme treffen und die angemessene Einhaltung der rechtlichen Vorschriften sicherstellen zu können. Zentral ist außerdem, dass jene Personen, die mit dem KI-System operieren, dessen Risiken und Chancen verstehen, um das System sachkundig einzusetzen und sich möglicher Schäden bewusst zu werden.

Dies beinhaltet im Konkreten folgende Kompetenzen:

- Risikoabschätzung: Welche Risiken bestehen beim Einsatz des infragestehenden Systems, insbesondere in Bezug auf die Gesundheit, Sicherheit und Grundrechte, und welche Auswirkungen haben KI-basierte Entscheidungen auf betroffene Personen?

- Rechtliche Kenntnisse: Welche rechtlichen Anforderungen sind einzuhalten, um Compliance mit dem AI Act zu gewährleisten?

- Technische Kenntnisse: Wie können die technischen Elemente des Systems korrekt angewendet bzw. dessen Ausgaben geeignet interpretiert werden?

- Unterschiedliche Ausgestaltung der Maßnahmen: bei der Entscheidung, welche Maßnahmen zur Sicherstellung der KI-Kompetenz ergriffen werden, ist miteinzubeziehen, über welche technischen Kenntnisse, Erfahrung und Ausbildung die zu schulenden Personen verfügen. Die Schulungsmaßnahmen können daher je nach Organisation und Kontext variieren.

Was bedeutet dies für Ihre Organisation?

Der AI Act fordert von Organisationen aller Art eine Anpassung ihrer Geschäftstätigkeiten sowie die Integration eines breiten Normenkatalogs. Insbesondere in Bezug auf verbotene Praktiken und die Sicherstellung von ausreichender KI-Kompetenz müssen betroffene Organisationen rasch handeln, da die einschlägigen Bestimmungen bereits ab 02. Februar 2025 für sie gelten.

Es ist daher anzuraten, eine Bestandsaufnahme zu machen und zu evaluieren, welche KI-Instrumente eingesetzt werden und über welche Kompetenzen jene Mitarbeiter*innen verfügen, die in die Entwicklung oder den Einsatz des Systems involviert sind. Zu beachten ist dabei, dass nicht nur, wie häufig angenommen, modernste Ansätze wie generative KI bzw. multimodale komplexe Modelle unter den Begriff des KI-Systems fallen, sondern auch ältere bewährte Ansätze wie logistische Regression und Entscheidungsbäume. Eine angeratene Inventarisierung von eingesetzten KI-Systemen wird daher häufig mehr Systeme als angenommen zutage fördern.

Da sich der AI Act bezüglich konkreter Leitlinien und Handlungsanforderungen bedeckt hält, empfiehlt es sich rechtliche Beratung in Anspruch zu nehmen, um Compliance mit den umfangreichen Regelungen des AI Act sicherzustellen.

Wenn Sie Unterstützung bei der Umsetzung des AI Act benötigen, stehen wir Ihnen gern beratend zur Seite. Kontaktieren Sie uns frühzeitig und stellen Sie sicher, dass Ihre Organisation auf die kommenden Verpflichtungen vorbereitet ist.

Unsere Expertise können sie auch in einigen Kommentierungen im umfassenden Werk „The EU Artificial Intelligence (AI) Act: A Commentary“ nachlesen.

Autorin

Dr. Madeleine Müller, BA, MU ist Senior Researcher und Senior Consultant am Research Institute – Digital Human Rights Center. Sie hat an der Universität Wien und an der Université Paris 1 Panthéon-Sorbonne Rechtswissenschaften und Philosophie studiert sowie den Masterstudiengang „Political Philosophy“ an der Universitat Pompeu Fabra Barcelona abgeschlossen. Im Rahmen ihrer internationalen Ausbildung hat sie den Fokus auf aktuelle Fragestellungen und Herausforderungen im Bereich der Grund- und Menschenrechte gelegt, wodurch sie eine interdisziplinäre Expertise in diesem Forschungsfeld entwickeln konnte. Nach einem Verwaltungspraktikum bei der Volksanwaltschaft und langjährigem ehrenamtlichen Engagement bei der Österreichischen Liga für Menschenrechte, verstärkt sie nun das Research Institute – Digital Human Rights Center mit Schwerpunkt auf interdisziplinäre Forschung an der Schnittstelle zwischen Recht und Geisteswissenschaften sowie in der Organisation und Betreuung der Research Institute-Academy (RIAC) und des network.fair.data.

Veranstaltungshinweis:

22. Jänner 2025 – 09:00-13:00 Künstliche Intelligenz: Rechtliche und ethische Aspekte in der Praxis

Wie sicher, vertrauenswürdig und rechtskonform ist künstliche Intelligenz? In unserem Workshop informieren wir Sie über Potenzial und Gefahren der Verwendung von ChatGPT & Co. Sie erhalten Grundlagenwissen über den Einsatz von KI im Licht der Anforderungen von Datenschutz, Menschenrechte und Cybersicherheit und über die Regulierung künstlicher Intelligenz im Kontext der Digitalisierungsoffensive der EU. Sie erfahren, welche Herausforderungen und Rahmenbedingungen Sie für den rechtmäßigen und ethischen Einsatz künstlicher Intelligenz in Unternehmen und Behörden beachten sollten.